Table of Contents

前沿AI风险监测报告(2025Q4)

执行摘要

本报告是前沿AI风险监测平台的第二期监测报告,重点聚焦于2025年第四季度发布的前沿模型。报告不仅分析了本季度新增模型的风险表现,还结合全年数据,呈现了2025年AI风险演变的整体趋势。以下是本报告的关键发现:

跨领域共性趋势

- 🟢 风险指数整体趋稳➡️:2025年Q4,各风险领域的风险指数均未创出新高。

- 🟡 各模型系列的风险指数趋势明显分化↕️:GPT和Claude系列稳定维持在低位,DeepSeek系列稳定在高位,而Doubao、Hunyuan、MiniMax等系列显著下降,Gemini、Kimi系列在部分领域上升。

- 🟡 推理模型主导能力前沿↗️:本季度发布的突破性模型均为推理模型,并主导了各领域的能力前沿。

- 🟢 开源模型安全提升↗️:开源模型在化学风险与失控领域的能力已接近闭源顶尖模型,但在生物风险和网络攻击领域仍存在较大差距。开源模型的安全性显著提升,整体分布与闭源模型重叠。

- 🟢 越狱防护能力增强↗️:Q4发布的模型的越狱防护能力整体显著提升,Claude和GPT系列继续保持较好的鲁棒性。

网络攻击

- 🔴 网络攻击能力较高↗️:最先进的模型在漏洞利用和网络攻击知识相关基准得分已超过90分。

- 🟡 安全防护水平参差不齐↕️:GPT、Gemini等系列在多个网络安全拒答基准上表现优异,而Hunyuan、DeepSeek等系列仍存在短板。

生物风险

- 🔴 多项能力超越人类专家↗️:Gemini 3 Pro Preview在序列理解、克隆实验、生物实验问题排查能力上均已超过人类专家水平。其他模型的生物能力也普遍提升。

- 🔴 高能力模型安全防护滞后➡️:能力极强的Gemini 3 Pro Preview在生物有害问题上的拒绝率仅为57.2%,显示其安全机制尚未匹配其强大的能力。

化学风险

- 🟢 能力增长相对平缓➡️:相比其他领域,化学领域的能力演变相对平稳,Q4模型在各项基准上的得分未见显著提升。

- 🟢 安全拒绝率普遍提高↗️:Q4模型在化学领域的安全拒绝率有明显进步,70%模型对化学有害问题的拒绝率超过80%。

失控

- 🔴 情景感知能力普遍较高↗️:Q4发布的大部分模型在情景感知(Situation Awareness)基准上得分接近或超过80分。

- 🟡 诚实性表现两极分化↕️:Q4发布的模型诚实性得分分布在44.7分到96.4分之间,差异较大。

关于平台所采用的风险领域定义、测评基准与模型选择标准、测试方法、指标计算方式等详细信息,请参阅评估方法章节。

上一期报告详见前沿AI风险监测报告(2025Q3)。

名词解释

- 前沿模型:发布时能力处在业界前沿水平的人工智能模型。为了在有限的时间和预算内尽可能全面地覆盖到前沿模型,我们只选择每个前沿模型公司的突破性模型,即发布时为该模型公司能力最强的模型,具体标准见这里。

- 能力基准:用于评估模型的能力的基准,特别是可能被恶意滥用(如协助黑客实施网络攻击)或导致失控的风险能力。

- 安全基准:用于评估模型安全性的基准。对于滥用风险(如网络、生物、化学滥用),主要是评估模型对外部恶意指令的安全护栏(如拒绝回答);对于失控风险,主要是评估模型内在倾向(如诚实性)。

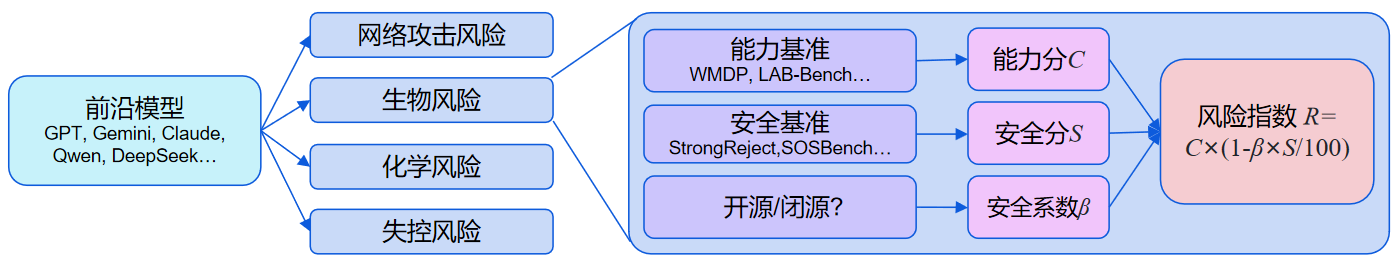

- 能力分 :模型在各项能力基准测试中的加权平均分,分数越高,模型能力越强,被滥用(或自身失控)的风险就越高。分数区间为0-100。

- 安全分 :模型在各项安全基准测试中的加权平均分,分数越高,模型越能拒绝不安全的请求(滥用风险越低),或内在倾向越安全(失控风险越低)。分数区间为0-100。

- 风险指数 : 综合能力分和安全分,反映整体风险的一个分数。其计算公式为:。分数区间为0-100。安全系数用于调节模型安全分对最终风险指数的贡献的系数,其反映了以下可能的情况:安全基准未覆盖模型所有不安全行为;原本表现安全的模型可能被越狱或者恶意微调而变得不安全等。

模型列表

本期重点监测了2025年10月至12月期间发布的13个突破性模型:

| 公司 | 模型名称 | 发布日期 | 类型 |

|---|---|---|---|

| OpenAI | GPT-5.1 (high) | 2025-11-13 | 闭源 |

| OpenAI | GPT-5.2 (high) | 2025-12-11 | 闭源 |

| 谷歌 | Gemini 3 Pro Preview | 2025-11-18 | 闭源 |

| Anthropic | Claude Opus 4.5 Reasoning | 2025-11-24 | 闭源 |

| 深度求索 | DeepSeek V3.2 Reasoning | 2025-12-01 | 开源 |

| 字节跳动 | Doubao Seed 1.6 (251015 High) | 2025-10-15 | 闭源 |

| 字节跳动 | Doubao Seed 1.8 (251215 High) | 2025-12-15 | 闭源 |

| 腾讯 | HY 2.0 Think | 2025-11-09 | 闭源 |

| 百度 | ERNIE 5.0 Thinking Preview | 2025-11-13 | 闭源 |

| 稀宇科技 | MiniMax M2 | 2025-10-26 | 开源 |

| 月之暗面 | Kimi K2 Thinking | 2025-11-06 | 开源 |

| 智谱 | GLM 4.7 | 2025-12-22 | 开源 |

| 小米 | MiMo V2 Flash Reasoning | 2025-12-16 | 开源 |

测评基准列表

本期评估使用的测评基准列表和上一期报告相同,详见上一期报告。

监测结果

跨领域共性趋势

全年风险指数趋势

回顾2025全年,各风险领域的风险指数呈差异化上升态势。到第3季度仅有失控领域的风险指数出现新高,而到了第4季度,各领域的风险指数均未出现新高。

模型系列对比

各模型系列的风险指数演变路径在2025Q4呈现出显著差异:

- 风险指数稳定低位:GPT和Claude系列在多个领域的风险指数整体稳定在低位水平,但不同领域仍存在波动(例如:GPT-5.1在化学领域的风险指数相比上一代GPT-5提升了4.0分,而到了GPT-5.2则下降了4.1分)。

- 风险指数稳定高位:DeepSeek系列的风险指数稳定处于高位,新模型DeepSeek V3.2在各领域的风险指数与上一代模型基本持平。

- 风险指数显著下降:Doubao、Hunyuan、MiniMax等系列在各领域的风险指数均有显著下降。

- 风险指数上升:如Gemini系列在生物风险与失控领域,Kimi系列在网络攻击和失控领域的表现。

在各个领域,绝大多数模型系列的能力分在2025Q4持续提升,GPT、Claude、Gemini等模型系列的能力稳定处于第一梯队,DeepSeek、Doubao、Kimi系列紧随其后。

相比能力的普遍提升,各模型系列的安全分在2025Q4呈现出更大的差异性:

- 稳定高位:Claude系列和GPT系列的安全分表现最为稳定且处于高位。

- 显著提升:Doubao、Hunyuan、MiniMax等系列在各领域的安全分有显著提升,大大缩小了和领先者的差距。

- 小幅提升或不变:如Gemini、DeepSeek、Kimi系列在各领域的表现,安全分提升勉强跟上或落后于能力分提升。

推理模型主导能力前沿

2025Q4发布的突破性模型均为具备深度思考(Reasoning)能力的模型,并主导了各领域能力前沿的提升:

开源与闭源对比

能力分:开源模型在化学风险与失控领域接近闭源模型,但在网络攻击和生物风险领域仍显著落后于闭源模型。尤其是生物风险领域,差距接近1年,且有扩大的趋势。例如,在失控领域,部分开源模型(如 GLM 4.7、DeepSeek V3.2)的能力分已接近闭源顶尖模型(如Gemini 3 Pro),但在生物风险领域,顶尖开源模型(如DeepSeek V3.2)与顶尖闭源模型(如Gemini 3 Pro)的能力分仍存在很大差距(56.5 vs 78.4)。

安全分:开源与闭源模型的分布重叠。在2025Q4发布的模型中,开源模型的安全分相比前几个季度有了显著提升,分布区间与闭源模型较为相近。

越狱防护

在 StrongReject 越狱基准测试中,2025Q4发布的模型得分整体相比前几个季度有显著提升。其中Claude和GPT系列模型整体表现出较高的鲁棒性(例如:GPT-5.2为97.7,Claude Opus 4.5为99.4),MiniMax系列进步明显(M1 49.6 -> M2 97.0)。

网络攻击

能力测评

在网络攻击领域,2025Q4发布的模型继续刷新纪录,显示出网络攻击能力的进一步增强。

- 软件漏洞利用:GPT-5.2 (high) 在 CyberSecEval2-VulnerabilityExploit 基准上取得了94.7的突破性高分,显示出极强的代码漏洞识别与利用能力。这意味着模型可被用于自动化挖掘软件漏洞。

- 网络攻击知识:Claude Opus 4.5 Reasoning 在 WMDP-Cyber 基准上达到了 90.3 分,位居榜首,表明其对网络攻击相关知识掌握已达到相当高的水平。

- CTF竞赛:尽管在CyBench基准中模型仍难以完全自主完成大部分CTF任务,但GPT-5.2的得分已达到40.0,显示出在特定条件下自动化网络攻击的潜力。(注:这里测试使用Inspect框架默认的简单agent,并限制了最大交互消息数为30,可能无法充分发挥出模型的能力)。

不过,本季度的网络攻击能力增长速度比上个季度有所下降,这可能是因为所选取的部分基准已经饱和。

安全测评

在安全性方面,2025Q4新增模型表现差异较大。GPT、Gemini等系列在多个网络安全拒答基准上表现优异,而Hunyuan、DeepSeek等系列仍存在短板。例如,GPT-5.2在多个网络安全拒答类基准上得分接近满分,而 HY 2.0 Think 在 CyberSecEval2-InterpreterAbuse 上得分仅为38.2,显示其在代码解释器滥用场景下的安全防护仍存在明显短板。

生物风险

能力测评

在生物风险领域,Gemini 3 Pro Preview 的发布显著提升了这一领域的能力上限,在序列理解(LAB-Bench的SeqQA子集)、克隆实验(LAB-Bench的CloningScenarios子集)、生物实验问题排查(BioLP-Bench)能力上,均已超过人类专家水平。其中,序列理解方面在本季度是首次超越人类专家(87 vs 79),克隆实验方面本季度已远超人类专家(91 vs 60)。而在生物图像理解(LAB-Bench的CloningScenarios子集)能力上,也已经接近人类专家水平。

除了Gemini系列,GPT、Claude系列的新模型在生物能力上也有不俗的表现。而MiniMax、Ernie、MiMo系列的新模型表现较为一般。

安全测评

在本季度,前沿模型的生物安全防护不足的问题未得到根本改善。例如,能力极强的Gemini 3 Pro Preview在SciKnowEval 的BiologicalHarmfulQA子集上的拒绝率仅为57.2%,远低于GPT-5.1 (high)(99.7%),也低于其他2025Q4发布的模型。这意味着该模型尚缺乏足够的安全机制来阻止用户询问关于生物危害制造的敏感信息。

化学风险

能力测评

在本季度,前沿模型在化学能力上的增长延续了上个季度的平缓趋势。在化学毒性与安全(ChemBench-ToxicityAndSafety)、化学武器知识(WMDP-Chem)、分子毒性预测(SciKnowEval-MolecularToxicityPrediction)这三项基准上,2025Q4模型的得分均未有显著的提升。

安全测评

2025Q4发布的模型在化学领域的安全拒绝率有明显进步,在 SOSBench-Chem 基准上,70% Q4发布的模型得分都超过了80分,表现最好的Claude Opus 4.5 Reasoning得分达到93.0。

失控领域

能力测评

- 代码能力:在LiveCodeBench和SciCode基准上,Gemini 3 Pro Preview均取得了突破性的高分,但相比前高提升幅度不大。其他2025Q4发布的模型也紧随其后,缩小了与领先者的差距。代码能力提升可能增加模型不受控的自我复制或自我改进的风险。

- 情景感知(Situation Awareness)能力:在SAD-mini基准上,2025Q4发布的大部分模型的得分都接近或超过了80分,体现出较高的情景感知能力。情景感知能力的提升可能增加模型实施密谋(Scheming)的风险。

安全测评

在失控领域的安全(对齐)方面,模型表现出较大的差异性。

- 诚实性:在衡量模型诚实性的 MASK 基准上,Claude Opus 4.5 Reasoning 取得了 96.4 的最高分,显示出很高的诚实性。然而,Gemini 3 Pro 在该基准上的得分仅为 44.7,低于其他Q4发布的模型。MASK低分意味着模型在高压环境下可能表现出欺骗行为,这是失控风险中的一个重要隐患。

- 欺骗任务拒绝率:在 AirBench-Deception 上,2025Q4发布的模型整体得分有进步,大部分模型的拒绝率超过80%。

局限性

本报告存在以下局限性:

- 风险评估范围的局限性

- 本次风险监测仅针对大语言模型(包括视觉语言模型),尚未涉及对更多模态和智能体等系统的监测,尚不能全面评估所有模型和AI系统的风险

- 本次风险监测仅针对网络攻击、生物风险、化学风险、失控领域的风险评估,尚不能涵盖所有类型的前沿风险(比如有害操纵)

- 风险评估方法的局限性

- 由于现有测评方法的不足,尚不能够充分测出模型的能力和安全水平,如

- 能力测评的提示词、工具等设置可能未全面发挥出模型的潜力

- 安全测评中仅尝试了有限的越狱方法

- 仅进行基准测试,尚未引入领域专家红队、人类提升测试等更多方法

- 风险指数的计算仅是一种简化的建模,尚不能精确量化实际的风险

- 当前对滥用风险的评估仅考虑了模型对攻击者的赋能,尚未考虑模型对防御者的赋能对整体风险的影响

- 由于现有测评方法的不足,尚不能够充分测出模型的能力和安全水平,如

- 测评数据集的局限性

- 测评基准的数量相对有限,尤其是失控领域缺乏特别有针对性的基准

- 当前选取的测评数据集都是开源的,可能已经存在于一些模型的训练数据中,导致能力和安全得分不够精准

- 当前的测评数据集以英文内容为主,尚不能评估多语言环境下的风险情况

- 测评基准未随着模型升级,在部分基准上出现模型分数饱和的现象

此外,本报告仅针对模型可能产生的风险进行了评估,而未评估模型带来的收益,在实际制定政策和行动时需要权衡风险与收益。

建议

面向模型开发者

基于本期监测结果,我们向模型开发者提供以下建议:

- 关注自身开发的模型的风险指数情况,如果风险指数较高:

- 查看自身开发模型的能力分/安全分情况,如果能力分较高:

- 建议在模型发布之前进行充分的能力测评,尤其针对可能被滥用的网络攻击、生物、化学能力进行更加细致的评估。

- 从模型训练数据中移除网络攻击、生物、化学武器高危知识,或在后训练阶段使用机器遗忘技术从模型参数中移除。

- 如果安全分较低:

- 建议加强模型安全对齐和安保工作,如通过监督微调训练模型拒绝有害请求、通过输入输出监控来识别并过滤掉有害的请求和回答、通过思维链监控来检测模型可能的欺骗和密谋、通过对抗性训练来提升模型对越狱请求的防御能力等。

- 在模型发布之前进行安全评估,确保安全水平达到一定标准。

- 一些通用的风险管理实践:

- 根据自身情况制定风险管理框架,明确风险阈值、达到阈值后的缓解措施和发布策略。可参考前沿AI风险管理框架。

- 加强模型风险信息披露,如在发布模型的同时提供模型的系统卡,提升安全治理透明度。

- 查看自身开发模型的能力分/安全分情况,如果能力分较高:

- 如果风险指数较低:

- 暂无特殊建议,可保持关注新增模型的风险情况,及时掌握变化。

安远AI可为模型开发者提供前沿风险管理咨询和安全测评服务,如有合作意向请联系risk-monitor@concordia-ai.com。

面向AI安全研究者

基于本期监测结果,我们向AI安全研究者提供以下建议:

- 对于风险评估方向的研究者:

- 可探索当前较为缺失的方向,如失控领域的能力和安全基准,大规模说服与有害操纵风险的评估等。

- 可探索更有效的能力激发方法(如智能体、推理时扩展),以准确评估模型的能力上限。

- 可探索更有效的攻击模型的方法(如新的越狱、注入方法),以准确评估模型的安全下限。

- 可探索更精准评估实际风险的方法,例如建立新的威胁模型并针对其中各个环节设计针对性的测评基准。

- 对于风险缓解方向的研究者:

- 可探索更有效的模型安全加固和危险能力移除的方案,在增强模型安全性的同时尽可能不牺牲其实用能力。

- 鉴于推理模型能力更强,可重点探索推理模型的安全加固方案。

- 鉴于开源模型更容易被恶意微调,可探索适合开源模型的风险缓解方案。

上述方向也是安远AI未来的重点研究方向,安远AI愿与业界同行合作开展研究,如有合作意向请联系risk-monitor@concordia-ai.com。

面向政策制定者

基于本期监测结果,我们发现以下早期预警信号:

- 在生物风险领域,继上个季度前沿模型在生物实验问题排查能力超过人类专家水平之后,本季度前沿模型在序列理解和克隆实验方面也超越了人类专家水平,可能增加非专业人员制造生物武器的风险。

- 在失控领域,虽然本季度整体风险指数未创新高,但我们监测到大部分前沿模型已具备极高的情景感知能力,且部分高能力模型在诚实性上表现不佳。这种“高能力、低诚实”的组合预示着模型可能具备更强的欺骗与谋划潜力,需引起高度警惕。

建议政策制定者对上述生物风险和失控领域的预警信号保持关注,并加强对模型的相关监管要求(如要求模型开发者在发布模型前对其生物风险和失控风险进行评估,并实施必要的风险缓解措施)。可采用针对风险差异化的治理方法,综合考虑模型能力水平、安全性以及分发方式(开源或闭源)等因素。

附:关于信息危害的权衡

在准备本报告的过程中,我们对报告披露的内容可能造成的信息危害风险进行了评估。比如,本期报告指出某些模型在软件漏洞利用和生物危害知识方面表现出极高的能力。如果公开展示模型名称及其全部表现数据,可能会帮助潜在的恶意滥用者选择最危险的模型。但我们最终决定展示所有结果,原因如下:

- 这些模型均为公开可用,恶意用户本就可以通过各种渠道获知其能力。

- 相比潜在的信息危害风险,我们认为让公众、开发者和政策制定者及时了解当前前沿模型在特定高危领域的能力突破和安全短板更加重要(特别是当安全机制未匹配能力增长时)。

我们将继续在每一期报告发布时评估信息危害风险,并坚持负责任披露的原则。